<まえがき>

昨年(2024年)のノーベル物理学賞の受賞者は、カナダトロント大学のジェフリー・ヒントンさんと米プリンストン大学のジョン・ホップフィールドさんの2名が選出された。受賞理由は「人工ニューラルネットワークによる機械学習を可能にする基礎的な発見と発明」であった。要するにAIの発見と発明である。

この発表に際して二つの疑問が示された。一つは「AIは物理学の範囲なのか?」そしてもう一つは「ホップフィールドやヒントン等の提唱したモデルや理論は、彼らより10年以上前に日本の甘利俊一が同様の理論を提唱しており、甘利も受賞対象者ではないか?」という点である。

第一の疑問に対してであるが、物理学とは「モノの理」「モノの理屈」を考える学問で、AIはモノではなく情報即ちコト「コトの世界」である。今回の受賞は、物理学を考える学者が「コトの世界」へ越境してきた現象を表している。この件に関しては、以下の第2の疑問を解き明かしていく過程で明らかにされる。

<過去のAI>*1

最初にAIを発明した人は、米国のフランク・ローゼンブラットで、1958年に人間のように情報を認識させる学習機械であるパーセプトロンが開発された。これは真空管で作成されたコンピュータで、脳神経の数にして10~15程度のものであった。パーセプトロンは例題を与えて学習し、利口になっていくシステムであった。この時期(1960年代)が、第1次のAIブームである。私の学生時代に聞いた話であるが、パーセプトロンでまずIQの低いAIを作成し、それを学習させてIQのちょっと高いAIを創造する。この過程を繰り返していけばIQ100のAIでもIQ200のAIでも作成が可能という理論がまかり通っていた。しかし1969年にパーセプトロンには、理論的にもハード的にも限界が明らかになり、ニューラルネットワークの研究は、一時的な停滞をもたらした。

この間、日本では東大数理工学科に所属していた甘利俊一博士がパーセプトロンの弱点である学習理論を補完する理論である「確率勾配降下法」を1967年に提唱し、1968年には世界初とみられる深層学習のシミュレーション成果を発表している。更に1972年には後の「ホップフィールドモデル」とほぼ同じモデルも提唱していたのである。これらの研究は解析的な成果であり、この時代はまだハード面が貧弱だったため甘利博士は実用化までは考えていなかった。

この当時のコンピュータは、やっと集積回路が用いられ始めたが、マイクロプロセッサは高々4ビットの時代である。8ビットのマイクロプロセッサは1974年、16ビットは1978年にリリースされた時代でもある。

1980年頃になって、当時の一部の物理学者が、物理分野の新たな研究課題を求めて、脳神経回路(ニューラルネットワーク)分野へ進出してきた。その成果として、1982年に米国のジョン・ホップフィールドが「ホップフィールドモデル」を提唱、1985年に英国のジェフリー・ヒントン等がホップフィールドモデルを基に現代の生成AIにつながる「ボルツマンマシン」を発表、1986年にはジェフリー・ヒントン等が「誤差逆伝播法」を提唱した。これは甘利博士の「確率勾配降下法」とほぼ同じアルゴリズムであった。これが第2次AIブームとなった。

ハード面としてコンピュータの発展もこのブームをバックアップしている。1985年頃はコンピュータの第5世代と言われ、集積化が進み超LSIやGIU(Graphical User Interface;マウス等による画面上の位置の指示により基本的な操作ができるもの)が発明され、これらの著しい発達によりAIの基礎ができてきた。

最初に述べた疑問の2番目の答えであるが、甘利博士は自ら「自分は理論的な発案はしたが、AIの発展には寄与していないので、ノーベル賞の受賞対象にはならなかった」と述べているが、皆さんはどう考えますか?私の個人的な見解では、やはり第1発見者は甘利博士であり、ノーベル賞受賞者に連座すべきではなかったのか?連座できなかったのは、ノーベル委員会が深堀りを怠ったのか、無視したのか?いずれにしても甘利博士を受賞者に加えなかったのは著しくノーベル委員会の栄誉が毀損されたと考える。

<現在のAI>

2022年10月にOpenAI社よりリリースされた対話型生成AIであるChatGPTにより、対話型AIが驚異的な成長を見せた。このChatGPTの言語能力は確かなもので、IQで評価するとOpenAI-01で120*2、OpenAI-04で155*3とも言われているが、数学的能力となるとかなり劣っていることが分かってきた。それを物語るような記事が、今年(2025年)の4月6日の日経新聞朝刊1面に報道されている。その記事によると、OpenAI-01とDeepSeek「R1」に東大入試問題を解かせたところ、英語は両者とも得点率は75%を超える高得点だったが、数学では苦戦しているようで、理科1類や理科2類での数学では120点満点中01は38点、R1は49点で合格者の平均点よりかなり低かったとの報道である。

生成AIの言語能力はニューラルネットワークを介しての回答ではなく、25万冊以上と言われる膨大な言語データを事前に学習し、最初の言語に続く言語をデータの中で確率的に判断して、文章を作成するという人間の思考回路とは異なった方法で文章を作成しているといえる。専門的に言うとLLM(大規模言語モデル)から内挿して解を求めており、言語の意味を理解して回答しているわけではないということである。

甘利博士も述べているが、ハード技術の発達で膨大なデータが扱えるようになり、そこから確率的に高い情報を組み合わせてみたら、うまくいったのが現在の姿で、理論的な裏付けは未だされていないとのことである。よく言われるように現在の生成AIでは、時に事実とは異なる答えを生み出すハルシネーション(もっともらしい嘘)を引き起こす欠点が指摘されている。

EUでは2024年5月にAIを規制するAI法が制定された。内容の詳細はここでは割愛するが、健康や安全、基本的権利などに対して有害な影響を及ぼすAIの利用を規制し、人間中心で信頼できるAIの導入を促進してイノベーションを支援するという趣旨の法律である。概略を示すと、AIシステムのリスクをリスクの高い順に、許容できないリスク(EU域内での使用禁止)、ハイリスク(厳格な要件と義務)、限定的なリスク(情報の透明性の義務)、最小限のリスク(規制対象外)の4つのレベルに分けて、それぞれのリスクレベルに応じた規制を設定している。

<未来のAI>

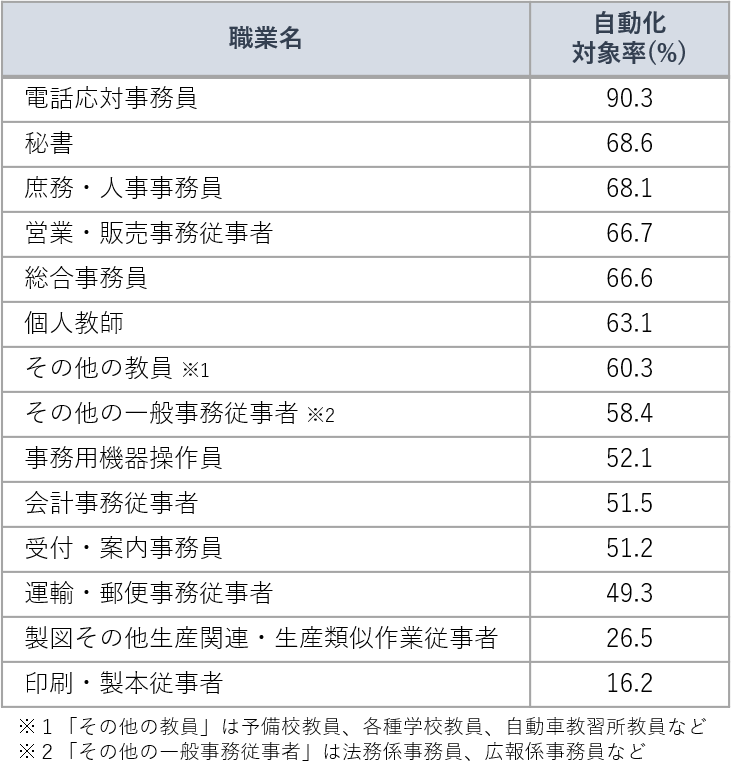

先に参照した週刊ダイヤモンドの記事によると、大和証券が日本の職業情報データベースを使ったビッグデータの分析結果が示されている。ここでは様々な職業と生成AIとの関係を「代替グループ」、「協働グループ」、「その他グループ」の3つに分類して検討しており、代替グループとは、仕事の主要部分が生成AIに取って代わられやすい職業で、日本の就業者の20.9%が該当する。協働グループとは、生成AIで単純作業を自動化し、より付加価値の高い業務で全体の18.1%がここに含まれる。その他グループとは、生成AIの影響を大きく受けない職業で61%が該当する。

表-2に代替グループに属する14職業のリストを示す。コールセンターオペレーターやテレホンアポインターなどの電話対応事務員が自動化対応率90.3%という高いポイントがあげられている。

以上のようにAIが発達してくると、いつの日か「人類の知能を超える日:シンギュラリティ(特異点)」が到来するのではないかとの議論は、盛んにおこなわれているが、確実な予測は困難であろう。先述したマルチモーダルで企業化している会社のCEOによると、「1年後のAIの世界は予測できるが、5年先、10年先の予測は不可能」と話していた*5。今年(2025年)の6月2~7日の日経新聞で特集が組まれ*6、米メタのチーフAIサイエンティストの言葉が載っていて「ChatGPTで採用されているLLMは基本的に限界があり、空間を認識する能力は4歳児以下」と語っている。このサイエンティストは最新のAGI(汎用人工知能)*7の研究者で、物理現象を理解するAIの開発に着手していると話す。

社会全体に影響を与える技術をGPT(汎用技術)*8と呼ばれ、古くは約1万年前の植物栽培に始まり、鉄や内燃機関、インターネットなどその数は24にものぼる。25番目のGPTになると見込まれているのがAGIだ。ただし、ひとたび誕生してしまうとそれは人類が生み出す最後のGPTになるかもしれない。その先のGPTは人類ではなくAGIが作り出すためである。

米国政府の支援を受けているオープングレーン社は2027年7月にAGIの達成を宣言しており、その後はそのAGIが自らを改良し始め2027年の後半には人間の知能をはるかに上回るASI(人工超知能)*9に到達できる、とも語っている。この宣言がどこまで信用できるかは明確ではないが、いずれにしても遅くとも2030年代にはシングラリティは到来すると予測する科学者は多い。シンギュラリティが到来した場合には、人間は心理的影響、認知能力への影響、感情や共感能力、アイデンティティの再定義、倫理観や価値観の再定義などに影響を及ぼすと考えられている。

甘利博士が語るAIの未来とは「AIが非常に便利になり、便利な道具として人工知能を使えば社会の生産性はもっと上がる。しかし放っておくと人工知能に人が使われて自分で考えなくなってしまう。人間が支配されることに喜びを感じてしまってAIの言う通りにやるとすべてうまくいくとなると人間の家畜化が進む。人間の尊厳や人間の自律性がAIに支配されるのではなく、人間としての尊厳を持つ、それを自覚することが非常に重要で、義務だと思う。日本全国の全員が楽しく働いてそれで楽しく生きていく社会の中で、一つの役割としてAIがいるという状況が一番いい」

重要なのはAIの発展に伴い人間の心の在り方も進化させていくこと、そして人間とAIの共生の在り方を慎重に検討することだと言えよう。

<むすび>

最近はどこを見てもAIの情報に溢れ、AIの文字を見ない日が無いほどである。更に日々進歩したAIを見せつけられ、正にAIブーム沸騰の感がある。その様な状況の中でこの記事をまとめているため、記述された情報の時期を明確にしておく必要があろう。最新情報は2025年6月10日に時限を設定し、それ迄に得られた新聞や雑誌、TV放送、インターネットなどを情報源としている。学会レベルでは更に進んだ研究成果も有るのかも知れないが、残念ながらそこまでは探りきれていない。

長々と書いてしまったが、最後にLLMの次の段階のAI(AGIやASI)が実用化された時に、甘利博士の確率勾配降下法が再確認され、ノーベル賞授賞の可能性を信じて筆を置く。

参考資料

*1 以上の議論の中で、甘利博士に関する記述の多くは、2025年2月12日にBSテレ東で放送された「今からサイエンス~ノーベル賞をもらうべきだった」を参考にしている。現在、甘利博士は理化学研究所の栄誉研究員である。

*2 https://note.com/orinokasa/n/na09373eeb38f 2025年6月10日参照

*3 https://note.com/chatgpt_nobdata/n/n1bfc32adacf4 2025年6月10日参照

*4 週刊ダイヤモンド 第112巻33号 2024年10/12・19合併号

*5 2025年2月1日テレ東で放送された「ブレークスルー~最新AIフル活用」

*6 2025年6月2日~7日日本経済新聞の特集「超知能 迫る大転換①~⑤」

*7 AGI:Artificial General Intelligence(汎用人工知能)

*8 GPT:General Purpose Technology(汎用技術)

*9 ASI:Artificial Super-Intelligence(人工超知能) ChatGPTの裏話:ChatGPTを公開したOpenAI社は2015年にNPOとして発足した。19年に営業部門を設置し、米マイクロソフト社と提携、22年に対話型AI「ChatGPT」を公開、24年に営利重視組織へ移行する計画を発表した。運営体制を巡っては混乱が続いており、25年5月に移行を断念している。現時点ではNPO理事会傘下の43兆円の価値のある営利企業を支配する特殊な組織である。(日経新聞2025年6月7日「きょうのことば」より)

安藤 啓(あんどう けい)

元 鹿島建設(株) 技術研究所